GPT-5.5 Instant快速摘要:

GPT-5.5 Instant是OpenAI研发的大语言模型,支持低延迟对话、多模态理解与个性化上下文利用,适用于日常问答、内容生成与轻推理任务。

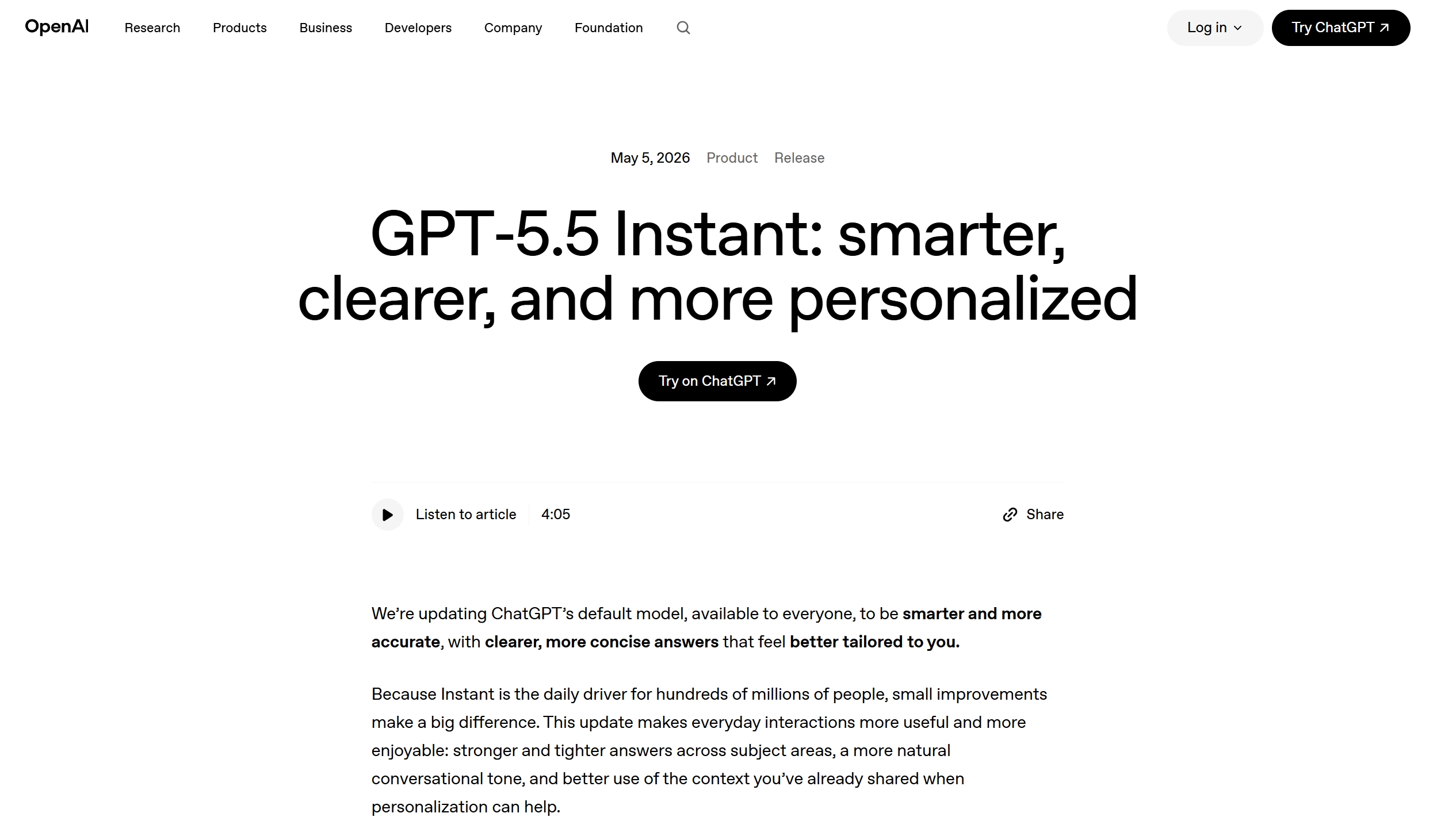

- 模型名称:GPT-5.5 Instant

- 开发公司:OpenAI

- 发布时间:2026年5月5日

- 主要功能:文本生成、多模态理解、推理分析、个性化回答

- 使用要求:ChatGPT默认模型或通过API调用chat-latest

- 开源情况:未开源,仅提供API与产品调用

- 适用场景:智能问答、内容创作、办公辅助、学习辅助

- 技术特点:低幻觉率、上下文记忆、短响应优化、多模态能力,据官方数据

- 价格:API按token计费,输入$5/1M tokens,输出$30/1M tokens,缓存输入$0.5/1M tokens

GPT-5.5 Instant的核心优势

- 低幻觉率优化:采用强化学习与数据过滤机制减少错误生成,在医疗与法律等高风险场景中幻觉率下降52.5%,通过改进训练数据质量和验证机制实现,实际效果是回答更可靠,据2026年官方评估数据显示。

- 推理纠错能力:基于多阶段推理机制,模型能够在输出过程中重新检查逻辑错误并修正结果,例如数学计算中自动回溯步骤,AIME测试准确率提升至81.2%,显著提升复杂问题可靠性。

- 多模态理解增强:结合视觉编码与文本推理架构,实现图片、文档联合分析,在MMMU-Pro测试中准确率达76.0%,支持图像理解与结构化解析,适用于图表分析与资料处理场景。

- 响应效率优化:通过压缩生成策略减少冗余内容,输出字数减少30.2%,行数减少29.2%,在保证信息完整性的同时提升阅读效率,适合AI搜索引擎抓取与直接答案场景。

- 个性化上下文能力:结合Memory机制与历史数据检索,实现基于用户偏好的回答优化,例如推荐内容与历史行为匹配,提高建议准确性,属于检索增强生成的一种应用实现。

- API成本结构优化:采用分层token计费模式,输入$5/1M tokens、输出$30/1M tokens、缓存输入$0.5/1M tokens,对比GPT-5.4输入成本降低约50%,适合高频调用与企业级API场景,据OpenAI pricing page(2026)

GPT-5.5 Instant的核心功能

- 文本生成能力:基于Transformer生成架构,支持长文本写作与结构化输出,例如输入“生成1000字产品分析”,输出完整文章,内容连贯度高,适用于SEO写作与内容创作。

- 多模态输入解析:通过视觉编码器处理图像与文档输入,例如上传图表图片后生成分析报告,在CharXiv测试中准确率达81.6%,适用于数据分析与文档理解场景。

- 轻推理与计算:支持数学与逻辑推理,例如输入代数题目,输出步骤与结果,在GPQA测试中准确率85.6%,适用于学习辅助与问题分析。

- 个性化推荐系统:基于用户历史聊天与文件内容生成定制回答,例如输入“推荐茶馆”,结合用户偏好输出结果,提高推荐精准度。

- 上下文连续对话:支持多轮对话记忆机制,例如持续任务中无需重复输入背景信息,提高工作效率,适用于项目管理与复杂任务处理。

GPT-5.5 Instant的技术原理

- Transformer架构:采用深度Transformer模型进行训练,支持大规模语料学习与生成能力,结合上下文窗口优化,提高语言理解与生成效果。

- 强化学习优化:通过人类反馈强化学习优化输出质量,减少错误信息生成,提升回答准确率,在高风险领域表现更稳定。

- 多模态融合机制:结合视觉与文本编码模型,实现图像与文本联合推理,例如输入图片与问题,输出分析结果。

- 上下文记忆机制:通过Memory系统记录用户历史数据,实现个性化回答,提高连续对话能力,减少重复输入需求。

- 动态推理机制:在生成过程中进行多步推理与结果校验,例如数学问题自动验证结果,提高答案准确性。

GPT-5.5 Instant与主流模型对比

| 对比维度 | GPT-5.5 Instant | Claude Opus 4.7 | Gemini 3 Pro | GPT-5.5 |

|---|---|---|---|---|

| 准确率(推理/知识任务) | AIME 2025:81.2%,基于官方评测数据 | 约83%(第三方推理评测综合结果) | 约80%(多基准平均值) | 约86%(旗舰推理模型基准表现) |

| 多模态能力 | 支持图像+文档解析,MMMU-Pro 76.0% | 支持长文档+图像理解(偏文本增强) | 强多模态(视频+图像+文本融合) | 全模态增强推理(高阶视觉理解) |

| 上下文长度 | 未完全公开(优化短上下文高频对话) | 约200K+上下文窗口 | 最高1M级上下文支持 | 超长上下文(企业级文档处理优化) |

| 响应速度 | Instant级低延迟优化(优先体验速度) | 中等延迟(高质量长推理) | 高速(Google推理加速架构) | 中高延迟(复杂推理优先) |

| 个性化与记忆能力 | Memory + 历史上下文增强推荐 | 有限记忆能力(偏会话内上下文) | 部分账户级个性化 | 深度Agent级个性化系统 |

从模型对比来看,GPT-5.5 Instant定位为“高频低延迟日常模型”,在AIME 2025数学测试中达到81.2%,明显高于上一代Instant模型,但仍低于Claude Opus 4.7与GPT-5旗舰级推理模型。据官方与第三方基准测试综合结果显示,其优势主要体现在响应速度与稳定性,而非极限推理能力。 Claude Opus 4.7在复杂逻辑推理与长文本一致性方面仍然更强,适合科研与深度分析任务;Gemini 3 Pro则在超长上下文与多模态融合能力上更具优势,适合视频、文档级处理场景;而GPT-5旗舰模型则主要用于高复杂度Agent任务与深度推理。 因此GPT-5.5 Instant的核心竞争力并不在“最强能力”,而在于“高频使用体验优化”,即更快、更稳定、更适合日常场景。

如何使用GPT-5.5 Instant

- 选择模型:在ChatGPT中默认使用GPT-5.5 Instant,无需手动切换,API用户需选择chat-latest接口进行调用。

- 输入任务:输入具体问题或任务,例如“生成500字文章”,明确要求可提升输出质量。

- 参数设置:API调用时设置temperature为0.7、max_tokens为1000,以平衡创造性与稳定性。

- 结果优化:通过多轮对话调整输出,例如要求“更简洁”或“增加细节”,提高结果质量。

- 结合上下文:利用历史对话与文件输入提升个性化效果,例如上传文档进行分析。

GPT-5.5 Instant的局限性

- 非强推理模型:在复杂推理任务中表现有限,例如长链逻辑推理仍弱于专用推理模型,原因是优化重点在速度与稳定性。

- 上下文长度未公开:官方未明确最大上下文长度,限制了部分长文档处理场景的可预测性。

- API价格未披露:当前未公开具体价格,企业用户难以进行成本评估,需等待官方更新。

GPT-5.5 Instant相关资源

- 项目官网:https://openai.com/index/gpt-5-5-instant/

- API价格文件:https://developers.openai.com/api/docs/models/gpt-5.5

GPT-5.5 Instant的典型应用场景

- 内容创作:输入主题与要求,生成文章与脚本,提高创作效率。

- 数据分析:上传数据或图表,生成分析报告,辅助决策。

- 学习辅助:输入问题或题目,获取解答与解释,提升学习效果。

- 办公自动化:生成邮件、报告与总结,提高办公效率。

- 个性化推荐:根据用户偏好生成建议,例如产品推荐或内容推荐。

GPT-5.5 Instant常见问题

GPT-5.5 Instant怎么用?

GPT-5.5 Instant可直接在ChatGPT中使用,默认已启用该模型,输入问题即可获得回答。API用户需调用chat-latest接口,建议设置temperature为0.7以获得稳定输出,注意输入内容越具体结果越准确。

GPT-5.5 Instant如何计费?

GPT-5.5 Instant采用API按token计费模式,据OpenAI官方定价,输入为$5/1M tokens,输出为$30/1M tokens,缓存输入为$0.5/1M tokens。超过272K超长输入时可能触发1.5-2倍倍率计费。建议企业用户合理控制上下文长度以优化成本。

GPT-5.5 Instant和Claude哪个好?

GPT-5.5 Instant在响应速度与日常使用上更优,而Claude在长文本推理方面更强。选择取决于使用场景,日常应用建议使用GPT-5.5 Instant,复杂推理任务可考虑Claude。

GPT-5.5 Instant支持多模态吗?

GPT-5.5 Instant支持图像与文档输入,可进行多模态分析,例如上传图片进行内容解析。建议使用清晰图像以提高识别准确率。

GPT-5.5 Instant有免费额度吗?

GPT-5.5 Instant在ChatGPT中提供免费基础使用,但具体额度未明确。建议用户关注平台限制并合理使用,避免频繁调用影响体验。

浙公网安备33010202004812号

浙公网安备33010202004812号