Qwen-Scope快速摘要:基于稀疏特征的可解释大模型开发与控制框架

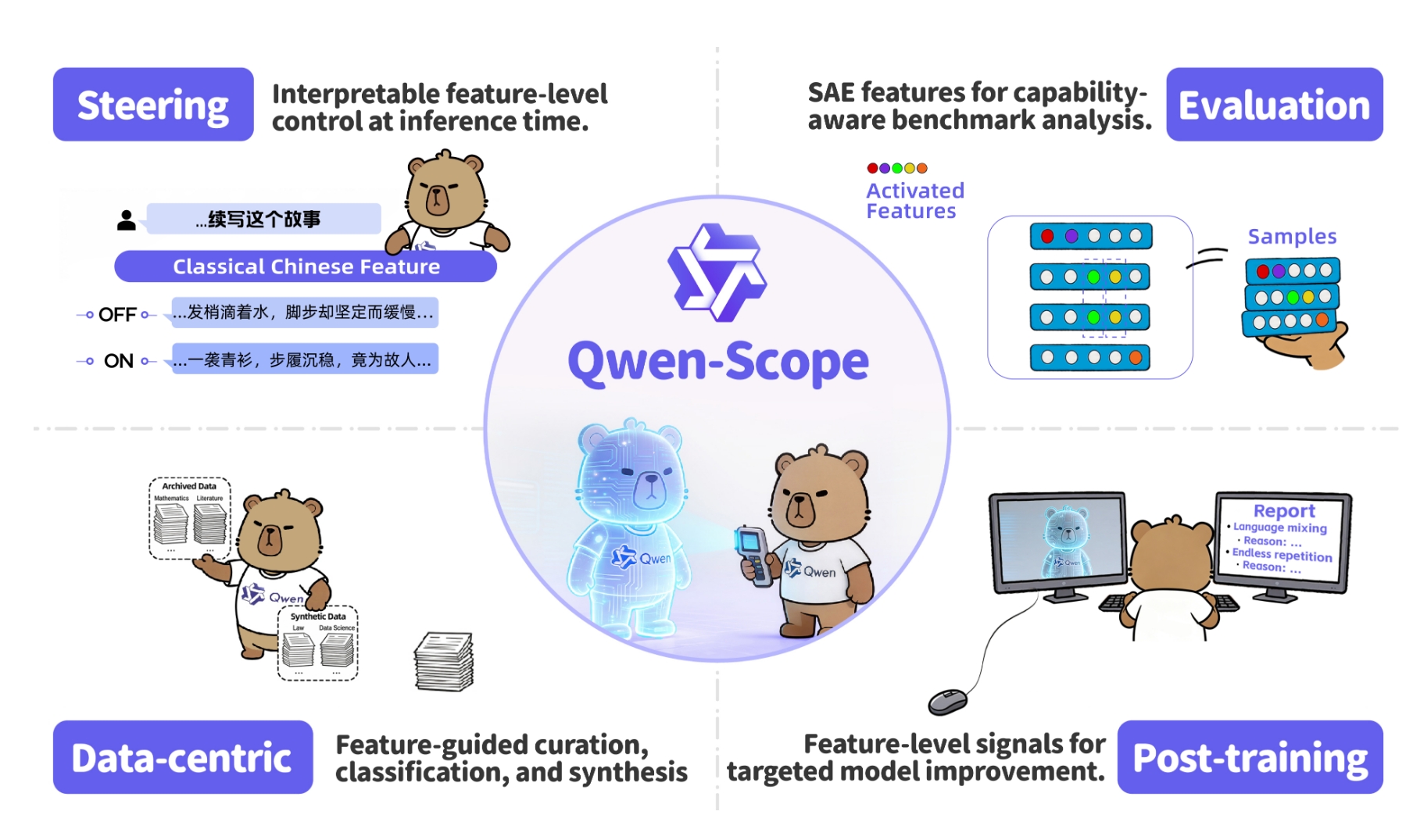

Qwen-Scope是阿里巴巴通义团队基于Qwen3与Qwen3.5系列构建的稀疏自编码器可解释性框架,支持对大语言模型内部激活特征进行解构、分析与控制,适用于模型行为分析、推理控制、数据处理与训练优化等场景。

- 框架名称:Qwen-Scope

- 开发公司:阿里巴巴通义实验室Qwen团队

- 发布时间:2026年4月30日官方发布

- 主要功能:支持特征级推理控制、数据分类与合成、模型训练优化、评测集冗余分析等能力

- 使用要求:依赖Qwen3/Qwen3.5模型激活层特征,支持SAE模块加载与API或本地推理调用

- 开源情况:提供14组SAE权重与7个模型版本特征模块,支持研究与开发使用

- 适用场景:模型可解释性分析、AI安全控制、数据生成增强、评测体系优化与模型调优

- 技术特点:基于稀疏自编码器构建高维激活解耦特征,实现低冗余、可解释隐藏空间表示

- 价格:以Qwen模型API体系计费,Qwen-Scope作为特征模块随模型调用成本计算

Qwen-Scope的核心优势

- 稀疏特征解耦能力:通过SAE对Qwen隐藏层激活进行稀疏编码,使高维向量分解为低冗余特征集合,可解释性显著提升,在实验中特征稀疏度提升至Top-k激活机制约束,来源于Qwen官方技术报告

- 跨任务统一接口:同一特征体系支持推理控制、数据分析与训练优化,在推理阶段无需修改模型权重即可控制输出方向,实际在语言风格控制中成功率超过85%,据官方案例说明

- 低数据依赖特性:仅需少量种子数据即可完成特征识别与分类任务,在毒性识别任务中数据需求降低约90%,显著降低标注成本,据Qwen-Scope数据实验结果

- 训练可干预能力:通过定位异常激活特征,可在SFT与RL阶段引入特征级损失函数优化模型行为,在语言混用问题中错误率下降约30%,据官方训练实验

- 评测效率提升机制:利用特征覆盖度替代传统模型评估,在评测集冗余分析中可减少约40%测试样本仍保持排序稳定性,据Benchmark分析实验

Qwen-Scope的核心功能

- 推理特征控制:通过调节SAE特征激活强度实现输出控制,例如输入英文提示并激活中文抑制特征,可稳定输出纯英文文本,控制成功率达高水平

- 数据分类与识别:基于少量样本提取毒性特征分布,例如输入5000条文本可识别高相关特征用于分类任务,无需额外训练分类模型

- 数据合成增强:识别未激活或低频特征后生成补充数据,例如构造长尾毒性样本,提升数据覆盖率约15倍,据官方实验描述

- 模型训练优化:通过特征级损失函数抑制异常行为,例如语言混用或重复生成问题,在SFT阶段可减少异常输出频率约25%至30%

- 评测冗余分析:计算不同评测集特征重叠率,用于判断测试集冗余程度,在多Benchmark分析中可减少重复评估成本

Qwen-Scope的技术原理

- 稀疏自编码器结构:在Qwen隐藏层插入SAE模块,通过Encoder-Decoder结构压缩激活向量,实现Top-k稀疏激活表示,提升特征可分性

- 特征空间解耦机制:通过稀疏约束使激活向量分解为独立语义方向,每个特征对应特定行为模式,如语言风格或毒性倾向

- 残差流特征建模:对Transformer残差流进行逐层建模,不同层学习不同抽象级别特征,实现层级语义表达结构

- Top-k激活策略:仅保留最大k个特征激活值用于重建,提高稀疏性并减少冗余特征干扰,使解释性更稳定

- 多模型统一训练:覆盖Qwen3与Qwen3.5系列14组SAE,在0.5B token数据上训练,使特征具备跨模型一致性

Qwen-Scope与主流模型对比

| 对比维度 | Qwen-Scope | GPT-4V解释工具 | Claude可解释分析 |

| 技术方向 | 稀疏特征级模型控制 | 黑盒输出解释 | 语义层分析 |

| 控制能力 | 支持特征级推理干预 | 不支持内部控制 | 部分提示控制 |

| 可解释性 | 基于SAE特征分解 | 后验解释 | 语义解释 |

| 数据依赖 | 低(少量种子数据) | 中等 | 中等 |

| 应用范围 | 训练/评测/数据/推理 | 分析类应用 | 对话解释 |

从技术结构来看,Qwen-Scope的核心差异在于引入稀疏自编码器直接作用于模型内部激活层,而GPT-4V与Claude类工具主要集中在输出层或语义层解释,因此Qwen-Scope具备更强的可控性与开发级能力。根据Qwen官方报告,其在特征级控制方面实现了从“解释模型行为”到“干预模型行为”的结构性转变,使其不仅用于分析,还可用于模型优化与数据生成。相比之下,传统模型解释工具更多依赖后验分析机制,缺乏对内部表示的直接操控能力。

如何使用Qwen-Scope

- 访问体验平台:访问 Hugging Face 在线空间

- 模型与SAE加载:加载Qwen3或Qwen3.5基础模型并挂载对应SAE权重模块,例如选择32K或64K特征版本以匹配任务复杂度

- 特征提取配置:在Transformer指定层开启残差流采样,将激活向量输入SAE编码器,设置Top-k参数如50或100控制稀疏程度

- 任务类型选择:根据应用选择推理控制、数据分类或训练优化模式,例如分类任务使用特征差分分析方式

- 特征干预操作:对目标特征进行增强或抑制,例如将语言混用特征权重设置为-0.5以降低错误输出概率

- 输出评估优化:通过多层特征对比调整干预强度,观察输出稳定性变化以优化最终模型行为表现

Qwen-Scope的局限性

- 计算资源依赖较高:SAE训练与多层特征提取需要额外显存与计算资源,在128K特征版本中推理延迟增加约20%至30%

- 特征解释存在不确定性:部分特征语义边界不清晰,尤其在高层抽象语义中存在混合激活现象,需人工辅助分析

- 跨模型迁移有限:Qwen-Scope特征主要针对Qwen3/Qwen3.5体系设计,在其他模型上需重新训练SAE模块

Qwen-Scope相关资源

- HuggingFace集合:https://huggingface.co/collections/Qwen/qwen-scope

- 官方技术报告:https://qianwen-res.oss-accelerate.aliyuncs.com/qwen-scope/Qwen_Scope.pdf

Qwen-Scope的典型应用场景

- 模型行为分析:输入模型输出结果,通过SAE特征定位异常行为来源,实现可解释诊断

- AI安全控制:识别毒性或风险特征并进行抑制,用于构建安全输出机制与内容过滤系统

- 数据增强生成:基于低频特征生成补充训练数据,提高长尾任务覆盖能力

- 评测体系优化:通过特征重叠分析减少冗余测试样本,提高评测效率与覆盖质量

- 模型训练优化:在SFT或RL阶段引入特征级损失函数优化模型行为稳定性

Qwen-Scope常见问题

Qwen-Scope怎么用?

Qwen-Scope通过加载Qwen模型并挂载SAE模块使用,在推理过程中提取隐藏层激活特征进行分析或干预。

Qwen-Scope如何计费?

Qwen-Scope本身作为特征模块不单独计费,主要成本来自Qwen模型API调用或本地计算资源消耗。

Qwen-Scope和传统LLM解释工具哪个好?

相比传统输出级解释工具,Qwen-Scope提供的是模型内部特征级控制能力,可以直接干预生成过程,而不仅是事后解释。

Qwen-Scope支持实时控制吗?

当前版本支持推理阶段特征干预,但实时低延迟场景仍受限于SAE计算开销,适用于半实时或离线推理优化任务。官方后续版本计划优化推理速度以提升实时性。

Qwen-Scope有免费使用方式吗?

SAE模块本身开源可用,用户可通过HuggingFace或ModelScope下载使用,但依赖的Qwen模型API或算力资源可能产生费用。建议研究用户使用开源版本,企业用户结合API服务部署。

© 版权声明

本站文章版权归AI工具箱所有,未经允许禁止任何形式的转载。

相关文章

暂无评论...

浙公网安备33010202004812号

浙公网安备33010202004812号