Ling-2.6-flash快速摘要:长上下文Agent模型能力与应用场景

Ling-2.6-flash是InclusionAI研发的开源大语言模型,支持长上下文推理、Agent任务执行与代码处理,适用于自动化工作流与开发场景。当前版本为104B总参数、7.4B激活参数,支持262K上下文长度与约33K最大输出。

- 模型名称:Ling-2.6-flash

- 开发公司:由InclusionAI发布,属于蚂蚁体系研究团队

- 发布时间:2026年4月21日官方发布,

- 主要功能:支持代码生成、长文档处理、Agent任务编排、API调用场景,Artificial Analysis测试中智能指数26分,主要面向高效率推理。

- 使用要求:支持API部署、OpenRouter类兼容接口与开源权重自部署,适合需要配置推理服务、自动化链路或模型网关的开发者使用。

- 开源情况:目前支持开放权重使用,属于open-weight模式;并非传统闭源商业API独占模型,这也是其与部分专有大模型的重要差异。

- 技术特点:采用稀疏MoE与Token Efficiency优化,据Artificial Analysis和第三方测试显示输出速度约208 tokens/s,延迟表现偏低。

- 价格信息:公开路由平台存在免费额度与低价API接入信息,不同平台API价格存在差异,需按提供商查看最新计费与免费额度政策。

Ling-2.6-flash的核心优势

- 长上下文处理优势:262K上下文长度支持大型代码库、长文档问答与多轮Agent状态保持,相比常见128K模型更适合复杂任务链处理,长上下文能力来自稀疏架构与推理优化设计,据官方文档和第三方测试数据均有验证。

- Token效率优势:模型重点并非极长推理链,而是单位Token任务效率,在Agent任务评测中强调更低Token消耗完成任务,据发布信息部分任务消耗可下降至同类模型约十分之一,适合成本敏感API场景。

- 推理速度优势:据Artificial Analysis测试输出速度约208 tokens/s,部分公开资料提及4卡H20推理可达更高吞吐,这种高速度对实时Agent调用、批量自动化任务和代码补全场景具有直接价值。

- 开源部署优势:开放权重模式支持私有部署、推理框架适配与API网关接入,相比完全闭源模型在数据合规、部署控制与成本优化方面更灵活,对企业自动化系统更友好。

- Agent任务优化优势:不同于纯聊天导向模型,Ling-2.6-flash更强调工具调用、计划执行与文档处理效率,据第三方评测其Agent导向设计优先面向执行链而非纯对话表现,这是定位层面的重要差异。

Ling-2.6-flash的核心功能

- 长文档问答:输入技术文档、合同或代码仓说明,可利用262K上下文进行结构化问答,例如输入数百页规范文档输出重点摘要与检索结果,适合知识处理场景,核心依赖长上下文推理机制实现。

- 代码生成与补全:支持代码解释、函数补全和仓库级理解,例如输入模块说明生成Python或TypeScript代码,据公开评测编码能力指数表现处于开源高效模型前列,适合开发辅助任务。

- Agent工作流执行:支持任务规划与工具调用链,例如输入“抓取数据并生成报告”可拆解子任务执行,这类功能重点不是深链推理,而是执行效率和调用稳定性优化。

- API自动化集成:可作为语义层接入业务API,例如客服路由、数据抽取、流程自动化,通过OpenAI兼容接口配置temperature、max_tokens等参数即可部署到工作流系统。

- 轻量成本推理:由于激活参数仅7.4B,模型重点在较低推理成本下维持可用性能,适合高并发批处理、AI Agent批量任务与预算敏感的开发测试环境。

Ling-2.6-flash的技术原理

- MoE架构:模型采用104B总参数但仅7.4B激活参数的稀疏专家架构,每次推理调用部分专家网络而非全部参数,以降低计算量并提升速度,这是效率来源之一。

- 长上下文机制:262K上下文能力意味着单轮可处理大型上下文窗口,背后通常结合高效注意力机制与缓存优化,适合代码库分析、多轮状态保持与文档推理任务。

- Agent强化训练:公开资料提及模型结合Agentic Reinforcement Learning方向优化,不仅训练问答能力,也优化任务规划、工具使用与执行稳定性,而非单纯文本生成。

- Token效率优化:模型强调在较少输出Token中完成目标,这与传统长链推理模型不同,重点优化生成路径压缩、响应直接性与执行效率,在自动化任务中价值更明显。

- 推理吞吐优化:据公开性能数据,模型在推理侧针对prefill吞吐与生成速度做专项优化,这也是其208 tokens/s速度表现与Flash命名定位的重要技术基础。

Ling-2.6-flash与主流模型对比

| 对比维度 | Ling-2.6-flash | Claude Opus 4.6 | Qwen3.6-Max-Preview |

|---|---|---|---|

| 上下文长度 | 262K | 约200K | 256K |

| 架构 | MoE开源权重 | 闭源专有 | 闭源旗舰 |

| 速度 | 约208 tok/s | 偏重质量 | 中高 |

| 多模态 | 当前文本为主 | 支持 | 当前以文本为主 |

| Agent效率定位 | 高 | 高 | 中高 |

| 部署方式 | API+自部署 | API | API |

从模型对比看,Ling-2.6-flash主要优势集中在速度、上下文长度和Token效率,而不是追求综合推理榜单绝对高分。根据Artificial Analysis测试数据,其智能指数26高于部分开源平均值,但与强调深推理的大模型路线不同。性能差异主要来自架构设计方向:Claude类模型偏高质量推理,多模态能力更完整;Qwen3在综合能力更平衡;Ling-2.6-flash则更适合Agent执行链、成本控制和长上下文自动化任务。若比较“哪个好”,取决于是追求Agent效率、复杂推理还是多模态能力,不属于同一优化目标。

如何使用Ling-2.6-flash

- 通过OpenRouter快速体验:访问OpenRouter注册并登录账号,在模型市场搜索 inclusionai/ling-2.6-flash:free 版本,选择免费路由入口。创建API Key后,调用OpenAI兼容接口接入模型。

- 配置标准API调用参数:请求中传入模型名称、API密钥及提示词结构,建议自动化任务场景将temperature控制在0.2至0.5,复杂Agent任务可设置较高上下文缓存并开启重试机制。

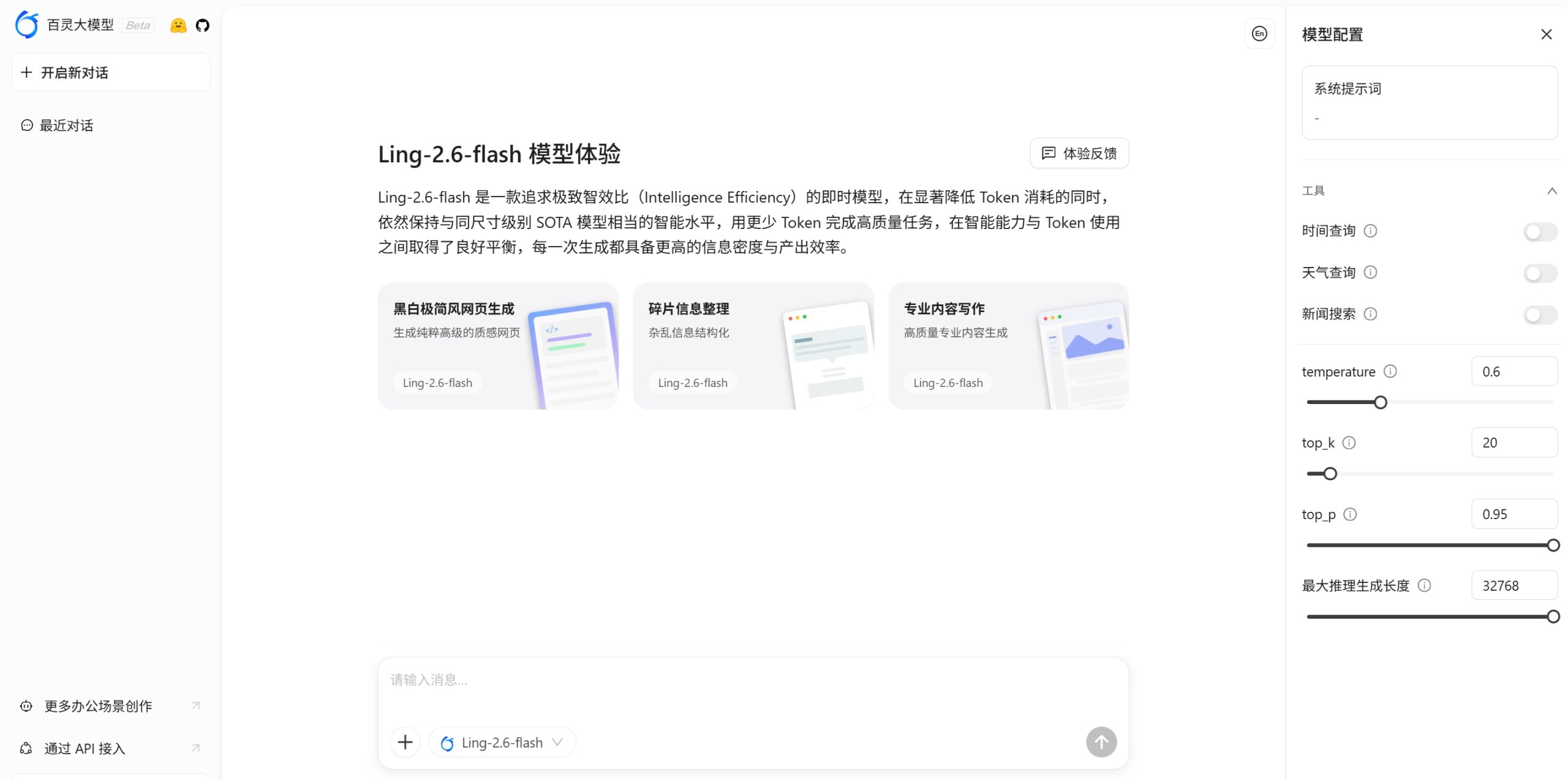

- 通过官方平台接入部署:访问百灵大模型官方平台完成注册,在控制台创建应用项目并生成API Key,按官方接口文档配置请求地址、鉴权参数与业务逻辑。

- 集成自动化工作流:可进一步接入RAG、Agent框架或工作流系统,将Ling-2.6-flash用于文档问答、工具调用或任务编排。

- 持续优化效果与成本:实际使用中重点监测输入输出Token消耗、平均响应速度与任务完成率。

Ling-2.6-flash的局限性

- 多模态能力有限:当前公开资料显示主要支持文本输入输出,不属于完整视觉多模态模型,对图像理解类任务支持不足,官方公开信息也未明确视觉扩展时间表。

- 深推理非主要强项:该模型偏Agent效率路线,在复杂长链数学或高难推理场景可能不如专门推理模型,部分社区测试也指出复杂任务稳定性存在差异,需按场景评估。

- 生态成熟度较新:2026年4月发布较新,生态、教程与第三方适配还在扩展阶段,相比成熟模型工具链支持较少,后续兼容性预计仍会迭代完善。

Ling-2.6-flash相关资源

- 官方模型接口文档:https://developer.ant-ling.com/zh-CN/docs/models/ling/

Ling-2.6-flash的典型应用场景

- 代码仓分析:输入大型项目文档与代码结构,利用长上下文做模块理解、缺陷定位和生成建议,输出结构化开发辅助结果,对工程协作有实际价值。

- 自动化Agent任务:输入任务目标如数据收集、分类和报告生成,通过任务拆解与工具调用执行输出结果,适合业务自动化链路场景。

- 长文档知识问答:输入合同、论文或手册,通过上下文推理输出问答与摘要,适合知识管理、检索增强和企业知识库应用。

- 高并发API推理:适合需要低延迟与高吞吐的API服务,如内容处理批任务、客服辅助与规则解析,输出稳定且成本可控。

- 预算敏感开发测试:适合开发阶段快速验证Agent设计、提示词结构与工作流逻辑,以较低成本获得较高测试频次和实验效率。

Ling-2.6-flash常见问题

Ling-2.6-flash怎么用?

主要通过API或兼容路由平台调用使用,配置模型名、密钥和生成参数即可。建议先用短上下文测试任务成功率,再扩展到长文档场景,同时关注Token消耗与提示词结构优化。

Ling-2.6-flash部署成本高吗?

Ling-2.6-flash采用104B总参数、7.4B激活参数MoE架构,相比同规模稠密模型推理成本更低。据公开资料,在H20等推理环境可获得较高吞吐。

Ling-2.6-flash和Claude哪个好?

如果比较复杂推理与成熟多模态,Claude路线更完整;若关注长上下文、速度与Agent执行效率,Ling-2.6-flash有独特优势。应按任务目标做模型对比,而非简单判断哪个好。

Ling-2.6-flash支持多模态吗?

当前公开资料显示主要支持文本输入输出,不属于完整视觉多模态模型。若任务涉及图像理解或音频处理,建议选择专门多模态模型,并关注官方后续更新计划。

Ling-2.6-flash免费吗?

模型权重属于开放使用模式,通常可免费研究或自部署使用,但推理资源并非零成本,本地部署需承担GPU算力成本,通过第三方API平台调用则可能存在计费。

浙公网安备33010202004812号

浙公网安备33010202004812号