Wan2.7-Video快速摘要(2026年4月更新)

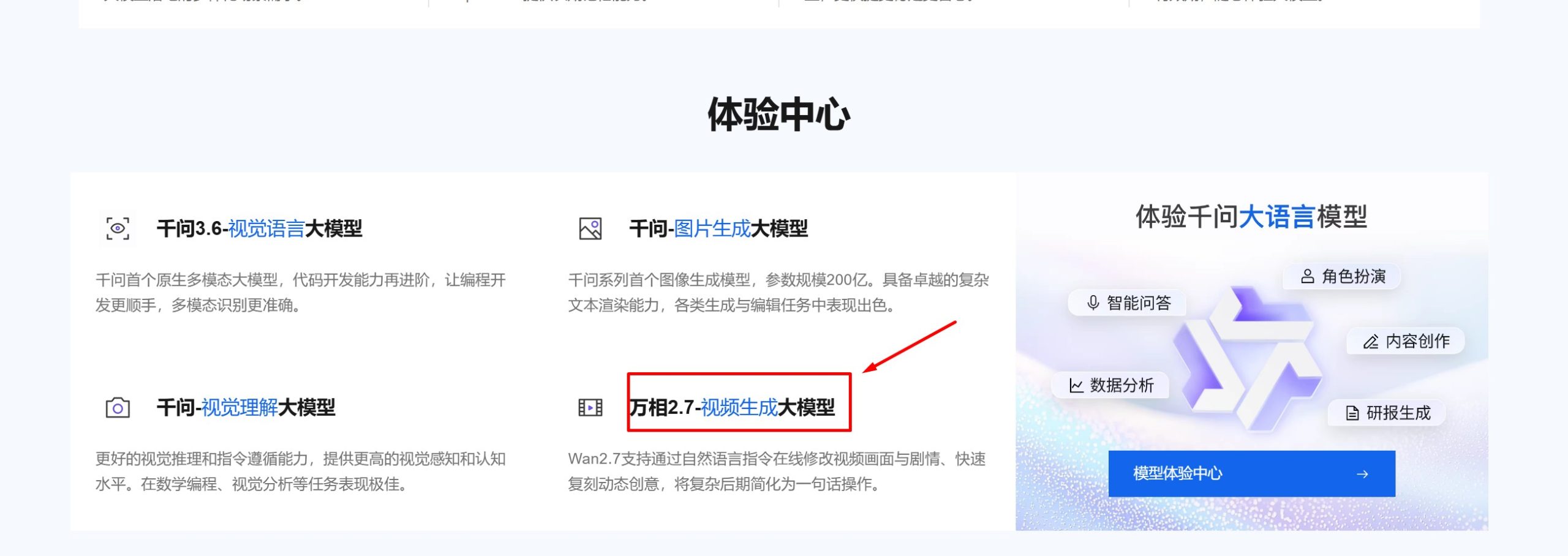

- 模型名称:Wan2.7-Video(含Wan2.7-VideoEdit、Wan2.7-i2v等能力),阿里通义实验室推出的视频创作大模型

- 开发公司:阿里云通义实验室,基于通义多模态模型体系构建的视频生成与编辑能力

- 发布时间:据通义实验室官方公众号2026年4月3日发布信息,Wan2.7-Video正式上线并开放体验

- 主要功能:支持视频生成、视频编辑、剧情修改、创意复刻、视频续写、角色控制与分镜控制等全链路创作能力

- 使用要求:需通过阿里云百炼平台调用API使用,配置API Key后进行图像、视频或文本输入生成视频内容

- 开源情况:据官方页面未披露开源信息,目前以闭源模型形式通过云端API提供服务

- 适用场景:短视频制作、广告创意、影视内容生成、IP动画制作、多角色剧情视频生成等

- 技术特点:基于多模态融合与扩散生成机制,支持文本、图像、视频、音频输入,实现视频级可控编辑

- 价格:据阿里云百炼平台显示,视频生成720P约0.6元/秒,1080P约1元/秒,支持免费额度体验

Wan2.7-Video的核心优势

- 戏核驱动的视频生成能力: 基于剧情结构建模,将剧本逻辑融入生成过程,据通义实验室发布说明模型通过学习专业剧本实现起承转合控制,生成视频在叙事连贯性上明显提升,适用于剧情类短视频与影视片段生成

- 多模态融合能力: 支持文本、图像、视频、音频多模态输入,通过Cross-Attention机制融合多源信息,据官方介绍可实现图像+语音+文本联合控制视频生成,显著提升创作灵活性与表达能力

- 视频可编辑性优势: 支持像文档一样编辑视频,通过局部修改与全局调整实现内容更新,据官方示例支持删除元素、替换物体与调整属性,减少重新生成成本约50%以上

- 角色与表演控制能力: 支持多角色一致性控制与40种以上表情表现,据官方说明角色音色、表情与动作可同步调整,在对话类视频生成中表现更自然真实

- 电影级运镜控制能力: 支持推拉摇移等基础运镜及复合镜头语言,据通义实验室说明可实现希区柯克变焦等复杂镜头效果,使视频具备更强叙事张力与专业感

Wan2.7-Video的核心功能

- 视频编辑功能: 通过扩散模型局部重绘机制实现视频内容修改,例如输入“删除画面中的路人”,系统仅修改目标区域并保持光影一致,据官方示例编辑后视频融合自然,适用于内容优化与二次创作

- 剧情修改功能: 支持对台词、动作与机位进行指令调整,例如输入“人物改为站立说话”,模型生成新的动作逻辑并保持场景一致,据官方说明可避免重新拍摄视频

- 创意复刻功能: 基于动态特征提取实现动作、运镜与特效复刻,例如输入参考视频生成同样运镜的新场景,据官方演示复刻效果在动作一致性上表现稳定

- 视频续写能力: 支持首尾帧控制与剧情延续,例如输入“接下来人物转身离开”,模型生成连续视频片段,据官方说明有效减少视频断裂感问题

- 角色控制功能: 支持最多5个角色一致性控制,通过图像与音频锁定外观与音色,例如生成多角色对话视频时保持人物特征一致,提升内容专业度

Wan2.7-Video的技术原理

- 扩散生成模型: 基于Diffusion逐步去噪生成视频帧,通过时间序列建模生成连续画面,据生成机制说明通过噪声反推生成高质量视频序列,适用于视频生成任务

- 多模态Transformer架构: 使用Transformer融合文本、图像与音频输入,通过注意力机制控制视频生成内容,例如输入图像与文本共同决定输出视频结构

- 时间一致性建模: 通过Temporal Attention机制保证帧间连续性,减少跳帧问题,例如在动作变化场景中保持流畅过渡

- 剧情结构建模: 引入剧本结构学习机制,将剧情逻辑嵌入生成过程,据官方介绍支持自动生成分镜与剧情发展路径

- 潜空间优化生成: 使用Latent Diffusion降低计算成本,在潜空间生成视频后再解码输出,提高推理效率并支持大规模生成

Wan2.7-Video与主流模型对比

| 对比维度 | Wan2.7-Video | Sora | Runway Gen-3 | Pika 1.0 |

|---|---|---|---|---|

| 核心能力 | 生成+编辑 | 生成 | 生成+工具 | 生成+工具 |

| 多模态支持 | 文本/图像/视频/音频 | 文本为主 | 文本+图像 | 文本+图像 |

| 视频控制能力 | 高(剧情+运镜) | 中 | 中 | 中 |

| 视频编辑能力 | 强 | 弱 | 中 | 中 |

| 调用方式 | API | 未开放 | SaaS | SaaS |

据官方资料与公开信息显示,Wan2.7-Video在视频编辑与可控生成方面具备明显优势,其核心差异在于支持“编辑+生成一体化”。相比Sora侧重长视频生成能力,据公开发布信息Sora支持更长视频片段,而Wan2.7更强调可控创作与剧情调整。Runway与Pika在工具化创作体验上较成熟,但缺乏深度剧情控制能力。性能差异主要来源于模型训练目标不同,Wan2.7通过引入剧情建模与多模态融合机制,在创作灵活性上更适合内容生产与商业应用场景。

如何使用Wan2.7-Video

- 注册与开通服务: 登录阿里云百炼平台创建账号并开通模型服务,获取API Key用于调用,建议开启按量计费并设置预算上限如100元避免超额费用

- 选择模型接口: 在模型市场选择Wan2.7-Video或VideoEdit接口,设置分辨率参数如720P或1080P,根据需求选择生成质量与成本平衡

- 输入素材与提示词: 上传视频或图像并输入描述如“删除背景人物并增加雨夜效果”,建议使用结构化提示词提高生成准确性

- 调用API生成视频: 发送请求获取生成视频结果,建议多次生成并筛选最佳输出,同时可调整提示词优化效果

- 优化与批量生成: 利用批量推理功能生成多个视频版本,通过缓存与参数调整提高生成效率与稳定性

Wan2.7-Video的局限性

- 视频时长限制: 当前生成视频多为数秒级片段,据官方示例通常在3-10秒范围,原因在于扩散模型计算复杂度较高,未来预计优化长视频生成能力

- 实时生成能力不足: 采用离线推理机制导致生成延迟较高,据体验反馈延迟通常在秒级以上,暂不适用于实时互动场景,预计后续版本优化流式推理

- 参数与性能数据未公开: 官方未披露模型参数规模与基准测试数据,限制了精确性能评估,用户需通过实际测试判断效果,未来可能逐步开放更多技术信息

Wan2.7-Video相关资源

- 万相官网:访问通义万相官网提供可视化操作界面,支持直接上传素材进行创作。

- 阿里云百炼:访问阿里云百炼进入模型广场,选择模型,可调用 API 或在网页端体验。

- 公众号官宣页:Wan2.7-Video 为创作自由而来

Wan2.7-Video的典型应用场景

- 短视频内容生成: 输入图片与脚本生成短视频内容,例如生成产品展示视频,输出可直接用于短视频平台,提高创作效率

- 广告创意制作: 输入商品图片与创意文案生成广告视频,通过批量生成提升营销内容产出效率

- 影视内容创作: 输入剧本生成分镜视频,实现低成本影视预演,提高制作效率

- IP动画制作: 输入角色图像与语音生成动画视频,实现虚拟角色内容生产与运营

- 社交媒体运营: 输入素材生成视频内容,适合个人创作者与企业账号提升内容更新频率

Wan2.7-Video常见问题

Wan2.7-Video怎么用?

Wan2.7-Video通过阿里云百炼平台API调用使用,用户需注册账号获取API Key,上传视频或图像并输入提示词生成视频,建议先测试短视频参数优化效果,同时注意素材清晰度会直接影响生成质量

Wan2.7-Video如何计费?

Wan2.7-Video采用按量计费模式,据平台定价720P约0.6元/秒,1080P约1元/秒,建议根据需求选择分辨率并控制生成时长,同时利用免费额度进行测试避免额外成本。

Wan2.7-Video和Sora哪个好?

Wan2.7-Video更适合视频编辑与可控创作场景,而Sora在长视频生成能力上更强,据公开信息Sora支持更长视频生成,建议根据需求选择模型,短视频与编辑场景优先Wan2.7。

Wan2.7-Video支持实时生成吗?

当前版本暂不支持实时视频生成,据技术架构说明采用离线推理方式,生成存在延迟,建议用于内容制作而非实时互动应用。

Wan2.7-Video有免费额度吗?

官方提供一定免费额度用于体验,额度用完即停止服务,建议在测试阶段合理控制调用次数,并关注平台活动获取更多试用资源。

© 版权声明

本站文章版权归AI工具箱所有,未经允许禁止任何形式的转载。

相关文章

暂无评论...

浙公网安备33010202004812号

浙公网安备33010202004812号