Wan2.7-Image是什么

Wan2.7-Image 是由阿里巴巴通义实验室推出的AI图像生成模型,属于通义万相体系中的重要版本,主要面向图像生成与编辑场景。该模型基于扩散模型与视觉语言联合训练架构构建,支持文生图、图生图、多图参考生成、图像编辑及组图生成等多模态能力。在推理能力方面,Wan2.7-Image 可处理较复杂提示词结构,支持最长不超过5000字符的输入,在多角色、多场景与多条件组合任务中保持较好的语义一致性。模型支持API调用,可通过HTTP或SDK接入实际业务系统,适用于自动化内容生产与设计流程集成。当前模型未完全开源,主要以平台服务形式提供,其性能定位偏向生产级图像生成,在图文融合、色彩控制与多模态推理方面具备稳定表现,适用于电商、品牌设计与内容创作等场景。

Wan2.7-Image的核心功能

- 文生图生成: Wan2.7-Image 支持通过文本提示词生成图像,用户输入如“未来城市夜景+霓虹灯+写实风格”,并设置size为2K与n=1,即可输出结构清晰且细节完整的图像,适用于广告草图生成与视觉内容制作。

- 图像编辑能力: 模型支持通过bbox_list参数进行局部编辑,例如上传图片并指定修改区域坐标,同时结合提示词完成内容替换,在产品设计与图片优化中可实现精准控制与高效修改。

- 多图参考生成: 支持在输入中传入多张参考图像并结合文本描述生成新图,例如输入人物参考图并指定风格,模型可保持角色一致性,在系列化内容与IP设计中具有实际价值。

- 组图连续生成: 通过enable_sequential参数启用组图模式,并设置n参数生成多张图像,例如生成连续剧情画面,实现时间序列一致性,在短剧分镜与故事板制作中提升效率。

- 色彩控制生成: 支持通过color_palette参数输入HEX色值与比例,例如设定品牌主色与辅助色占比,模型在生成过程中保持色彩一致性,适用于品牌视觉规范与营销素材制作。

Wan2.7-Image的技术原理

- 扩散生成机制: Wan2.7-Image 基于扩散模型,通过从随机噪声逐步去噪生成图像,在训练中学习图像分布,在推理中通过采样与参数控制输出质量,适用于高质量图像生成任务。

- 跨模态语义对齐: 模型通过视觉与语言联合训练,将文本描述映射为图像语义结构,例如复杂提示词可被拆解为多个视觉要素,从而生成结构一致的图像内容。

- 上下文解析能力: 支持最长不超过5000字符的提示输入,通过上下文编码器处理多条件组合描述,例如人物、环境与动作同时存在时仍可保持语义一致性。

- 多模态融合推理: 在输入图像与文本时,模型通过融合编码实现跨模态推理,例如参考图+风格描述生成新图像,在设计迭代与风格迁移中提升效率。

- 参数化控制机制: 支持通过size、n、seed与thinking_mode等参数控制生成过程,例如通过固定seed提升一致性,通过thinking_mode增强推理能力,在复杂场景生成中提高稳定性。

Wan2.7-Image与主流模型对比

| 对比维度 | Wan2.7-Image | Midjourney | 即梦AI |

|---|---|---|---|

| 模型架构 | 扩散模型+多模态融合 | 扩散模型 | 多模态生成模型 |

| 推理能力 | 支持复杂结构与多条件解析 | 偏艺术表达 | 中文语义较强 |

| 文本渲染 | 支持图文混合生成 | 文本稳定性较弱 | 支持基础文字生成 |

| 一致性控制 | 支持多图参考与组图生成 | 依赖随机种子 | 支持参考图生成 |

| API能力 | 支持标准API与SDK调用 | 无官方API | 支持平台接口 |

| 适用场景 | 生产级设计与内容生成 | 艺术创作 | 短视频与内容制作 |

从模型对比来看,Wan2.7-Image 在推理能力与结构控制方面更偏向工程化应用,适合需要稳定输出与批量生成的场景,例如品牌设计与电商视觉生产。Midjourney 更侧重艺术表达与视觉风格,在创意生成与光影表现方面具有优势,但在结构控制与文本生成方面稳定性较弱。即梦AI在中文语义与多模态内容生成方面表现较均衡,适用于短视频与内容制作场景,但在复杂结构生成与一致性控制方面仍有提升空间。因此,在需要高一致性与可控生成的业务中,Wan2.7-Image 更具实际应用价值。

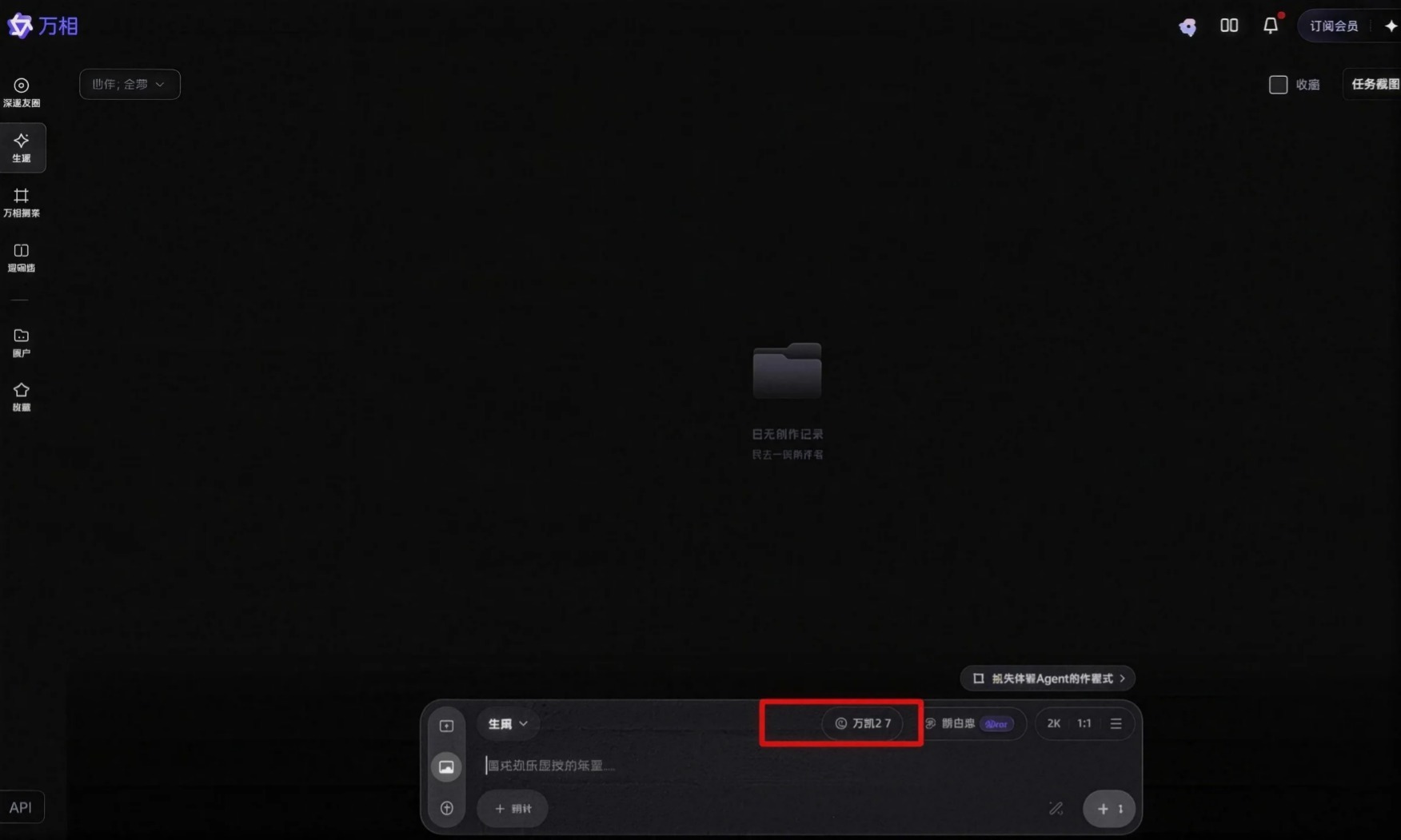

如何使用Wan2.7-Image

- 普通用户:直接访问通义万相官网,注册并登录操作界面,输入描述即可生成图像。

- 开发者:访问阿里云百炼平台,按以下步骤接入 API

- 1)获取API并配置环境: 在平台获取API Key并配置到环境变量中,例如设置DASHSCOPE_API_KEY,确保后续请求能够通过身份认证并正常调用模型接口。

- 2)构建输入内容: 在messages中输入提示词,例如“现代建筑+夜景+商业风格”,并根据需求添加image字段实现图文输入,在复杂任务中建议使用结构化描述提升生成准确性。

- 3)设置生成参数: 配置size、n、seed与thinking_mode等参数,例如设置size为2K、n为1,并开启thinking_mode以增强推理能力,在复杂场景中提升生成质量。

- 4)执行请求获取结果: 通过HTTP或SDK发送请求,例如使用POST接口提交数据,模型返回图像URL,在实际系统中可用于自动化生成流程。

- 5)优化输出与复用: 根据生成结果调整提示词与参数,例如固定seed保持一致性或调整描述细节优化效果,在批量生成任务中实现稳定输出。

Wan2.7-Image相关资源

- Wan2.7-Image官方API文档:https://bailian.console.aliyun.com/cn-beijing?tab=api#/api/?type=model&url=3026980

Wan2.7-Image的典型应用场景

- 品牌视觉设计: 输入品牌风格与颜色参数,例如通过color_palette定义主色比例,生成符合品牌规范的视觉素材,用于广告与营销内容制作。

- 短剧分镜制作: 使用组图生成模式输入剧情描述,例如生成连续场景画面,实现角色一致与风格统一,在内容制作中提升效率。

- 电商商品展示: 输入商品与场景描述,例如“手表+商务背景”,生成商品展示图,在电商页面与广告投放中提升视觉效果。

- 教育内容生成: 输入教学内容与图示需求,例如“化学实验流程”,生成图文结合内容,在教学与培训中提高表达效果。

- 媒体与内容创作: 根据文章或脚本生成配图,例如生成插画与封面图,在自媒体与内容平台中提升内容吸引力。

关于Wan2.7-Image的常见问题

Wan2.7-Image支持哪些生成模式?

支持文生图、图生图、多图参考生成以及图像编辑等多种模式,用户可以根据具体任务选择不同输入方式。在实际使用中建议结合提示词与参数配置,例如通过结构化描述提升生成准确性,同时注意输入格式规范以保证输出稳定性。

如何提高Wan2.7-Image的生成一致性?

可以通过设置seed参数来增强生成结果的稳定性,同时结合多图参考输入与统一提示词结构来保持风格一致。在批量生成或系列内容制作中,建议固定核心参数并减少提示词波动,以降低结果差异。

Wan2.7-Image是否支持高分辨率输出?

专业版模型支持更高分辨率输出,例如通过size参数选择4K规格,在文生图场景中可获得更清晰细节效果。但需要注意高分辨率会增加生成时间与成本,建议根据实际需求合理选择分辨率配置。

Wan2.7-Image是否支持异步调用?

支持通过异步方式提交生成任务,并通过任务ID轮询获取结果,适用于处理时间较长或批量生成场景。在实际系统中建议使用异步模式提升稳定性,并结合任务状态管理实现自动化流程。

Wan2.7-Image生成的图像可以保存多久?

模型返回的图像通常以URL形式提供,默认有效期为24小时,超时后将无法访问。在实际使用中建议在生成完成后立即下载并存储到本地或对象存储中,以避免数据丢失影响后续使用。

浙公网安备33010202004812号

浙公网安备33010202004812号