PixVerse V6是什么

PixVerse V6 是由 爱诗科技( PixVerse) 于 2026 年 3 月 30 日发布的最新一代AI视频生成模型,定位为面向专业创作与商业生产流程的多模态视频生成系统。相较早期版本仅支持短片段生成,PixVerse V6 实现了从“单段生成”向“完整视频生产工作流”的转变,支持最长 15 秒 1080P 视频输出,并可在一次生成中完成多镜头叙事与原生音频同步生成。该模型支持文本生成视频、图像生成视频、首尾帧过渡及视频延长等能力,具备较强的多模态理解与推理能力。PixVerse V6 提供 API 与 CLI 接入方式,可集成至开发者工作流与 Agent 系统中,适用于自动化内容生产。当前模型未开源,采用平台化服务提供。从性能定位来看,PixVerse V6 重点优化镜头控制、角色表现、物理一致性与音视频协同生成能力,在商业视频、广告制作及叙事内容生成中具备更高的稳定性与可控性。

PixVerse V6的核心功能

- 多镜头视频生成: PixVerse V6 支持通过单一提示生成包含多个镜头切换的视频序列,用户可在提示中描述“远景到特写”等镜头变化,模型自动完成镜头衔接与视觉一致性,适用于广告视频与短剧制作场景。

- 原生音视频同步生成: 模型可在生成视频的同时输出同步音频,如环境声、对白或动作音效,用户可在提示中加入“脚步声”“引擎轰鸣”等描述,实现音画同步输出,减少后期音频处理成本。

- 电影级画面真实感: 在人物表情、皮肤质感与光影细节方面显著优化,用户输入“微笑表情”“情绪变化”等描述时,模型可生成更自然的角色表现,降低画面变形与AI感。

- 镜头控制与运动表达: 支持复杂镜头语言,如跟拍、旋转、POV视角等,用户通过提示描述镜头路径与运动方式,可生成更具电影语言的视频内容,适用于影视预演与创意制作。

- 复杂场景与物理一致性: 在高速运动、粒子效果与场景交互中保持稳定,如“爆炸”“碎片飞溅”等场景中主体仍保持清晰,适用于动作类视频与特效内容生成。

PixVerse V6的技术原理

- 视频扩散生成架构: PixVerse V6 基于扩散模型进行视频生成,通过逐帧去噪结合时间建模实现连续画面输出,在实际应用中可保证视频在运动与细节上的平滑过渡。

- 多镜头时序建模: 模型引入多镜头生成机制,在同一生成过程中管理不同视角与场景切换,通过时间一致性约束保持主体与背景稳定,适用于叙事类视频制作。

- 音视频联合生成机制: 通过统一生成框架同时输出视频与音频内容,在推理阶段对声音与画面进行同步建模,使动作与音效匹配,提升沉浸感与真实感。

- 空间与物理一致性建模: 模型对物体运动、碰撞与光照变化进行建模,在复杂场景中保持空间关系一致,如高速移动或光线变化场景中仍可保持结构稳定。

- 多模态语义理解: 支持文本与图像输入融合处理,通过统一编码器解析语义信息,在生成阶段映射为视觉与音频输出,实现更高精度的内容表达与控制。

PixVerse V6与主流模型对比

| 对比维度 | PixVerse V6 | Runway Gen-3 | Pika 1.0 |

| 模型定位 | 生产级AI视频生成模型 | 创意导向视频生成模型 | 轻量级视频生成工具 |

| 视频时长 | 最长15秒 | 约10秒 | 约4-6秒 |

| 分辨率 | 最高1080P | 最高1080P | 最高720P |

| 多镜头生成 | 支持单次生成多镜头 | 需多次生成组合 | 支持有限 |

| 原生音频 | 支持 | 不支持 | 不支持 |

| 镜头控制 | 较强 | 较强 | 一般 |

| 物理一致性 | 稳定 | 较好 | 一般 |

| 工作流能力 | 完整生产流程 | 偏创意制作 | 偏快速生成 |

| 开发支持 | API+CLI | API | 部分支持 |

PixVerse V6 更偏生产级应用,支持多镜头与音视频一体生成,适合商业内容制作;Runway 更侧重画面质量与创意表达;Pika 更适合轻量快速生成。

PixVerse V6 与 V5.6 的架构升级

| 对比维度 | PixVerse V5 | PixVerse V6 |

| 核心架构 | 模板驱动 | 模型驱动 |

| 主要用途 | 短视频生成 | 商业视频生产 |

| 叙事能力 | 依赖拼接 | 单次多镜头生成 |

| 音频处理 | 后期添加 | 原生生成 |

| 一致性 | 不稳定 | 稳定 |

| 生成逻辑 | 视觉效果驱动 | 叙事与物理驱动 |

V6 从模板生成升级为模型驱动,支持多镜头与音频一体输出,一致性与稳定性明显提升,更适合完整视频制作。

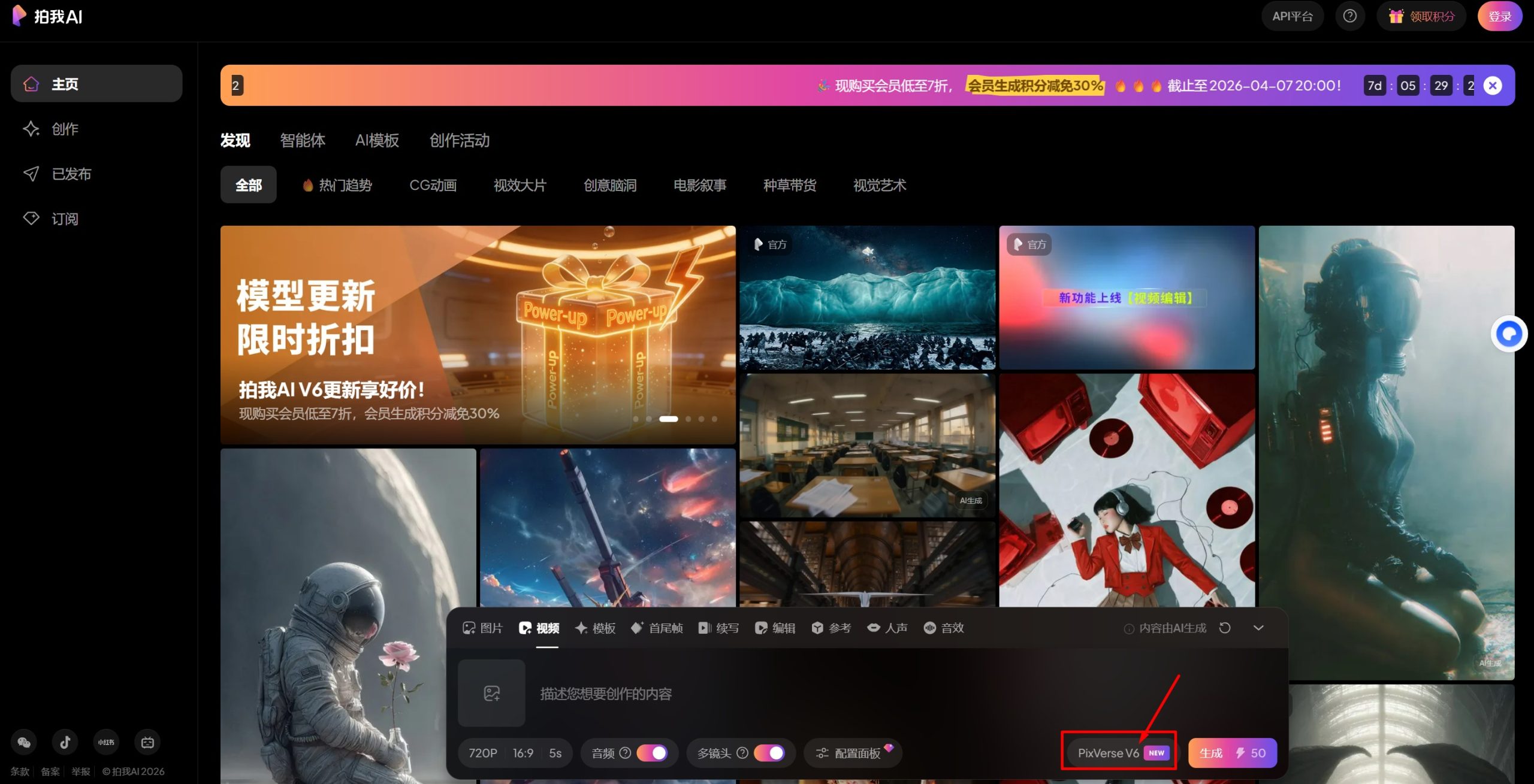

如何使用PixVerse V6

- 选择模型与基础配置: 登录拍我AI官方平台或者国际平台Pixverse后选择 PixVerse V6 模型,设置分辨率为1080P并将时长调整至15秒,同时根据发布平台选择16:9或9:16比例,以确保输出符合实际使用需求。

- 构建物理描述型提示: 输入具体场景描述,如“汽车在阳光下行驶,镜头从后方跟拍”,避免抽象描述,通过明确动作、光线与镜头信息提升生成稳定性。

- 定义镜头与音频内容: 在提示中加入多镜头描述,如“切换至特写镜头”,并补充音频信息如“引擎声逐渐增强”,实现多镜头叙事与音画同步生成。

- 调整参数与生成: 根据需要开启多镜头或音频选项,设置质量参数如720P或1080P,点击生成后等待模型推理输出视频结果。

- 优化输出与迭代: 预览生成结果,若出现运动过快或不稳定情况,可调整提示词中的动作强度或镜头描述,重复生成以获得更理想效果。

PixVerse V6的典型应用场景

- 多镜头广告制作: 用户输入产品描述与镜头切换指令,生成完整广告视频,减少拍摄与剪辑成本,提高营销内容产出效率。

- 跨语言本地化视频: 利用模型支持多语言文本生成,在同一视频中生成不同语言内容,适用于全球市场推广。

- 短剧与叙事视频: 通过多镜头与角色表现能力生成剧情视频,适合短剧创作与内容平台发布。

- 电商批量内容生产: 输入商品信息生成展示视频,可批量生成多条内容,用于商品详情页与广告投放。

- 自动化视频工作流: 通过API或CLI接入系统,实现视频自动生成与发布,适用于企业级内容生产场景。

PixVerse V6 常见问题解答(FAQ)

我可以使用 PixVerse V6 视频进行商业营销吗?

是的,商业使用权取决于您的订阅级别。为了符合 2026 年海外营销标准,建议选择 Pro 或 Ultra 套餐,这些套餐允许您在典型的付费社交媒体平台和网站广告位上使用 1080P、最长 15 秒的视频输出。请务必在 PixVerse 定价页面查看您的当前套餐状态,以确保符合您所在地区的要求。

一段 15 秒的 1080P 视频需要消耗多少积分?

生成 15 秒 1080P 视频比生成 5 秒 720P 视频需要更多计算资源。积分消耗与视频时长、分辨率以及多镜头或复杂动作指令相关。一般而言,多镜头、动作复杂或有原生音频的视频会显著增加消耗量,建议先进行测试生成以预估积分使用。

如何在多镜头序列中保持角色一致性?

V6 会遵循您提示中提供的物理锚点。在镜头切换时保持一致性,建议在每个镜头的描述中重复核心特征。例如,镜头 1 描述“一位金发碧眼、身穿蓝色丝绸衬衫的女士”,镜头 2 也应包含相同描述,以锚定模型生成引擎,减少过渡期间的视觉漂移。

如何优化提示词以提升生成稳定性?

提示词应尽量具体,包括动作、光线、场景、角色特征及音效描述,避免抽象或模糊表达。明确的物理和语义描述可以增强模型对连续镜头和多模态内容的理解,提高视频生成的稳定性和一致性。

PixVerse V6 是否支持长视频生成?

当前版本支持最长 15 秒的视频输出。对于更长视频,建议将内容分段生成并在后期进行拼接,以确保画面质量和多镜头连贯性。

PixVerse V6 能否生成同步音频?

可以。V6 支持原生音频输出,包括环境声、对白和动作音效。通过在提示词中描述音效内容(如“汽车引擎声”“脚步声”),模型会在生成视频的同时同步生成音频,减少后期处理工作。

如何在多镜头视频中保持光影和场景一致性?

在每个镜头描述中保持相同的光照和场景关键元素描述,例如“阳光从右上方射入,室内温暖黄色光”,可以帮助模型在不同镜头间维持环境一致性。

PixVerse V6 提供哪些商业级使用工具?

用户可通过官方生成平台、API 接口或 CLI 工具进行商业级视频生成与批量处理。API 和 CLI 接入适合企业内容生产流程,实现自动化生成和发布。

浙公网安备33010202004812号

浙公网安备33010202004812号