Matrix-Game 3.0是什么

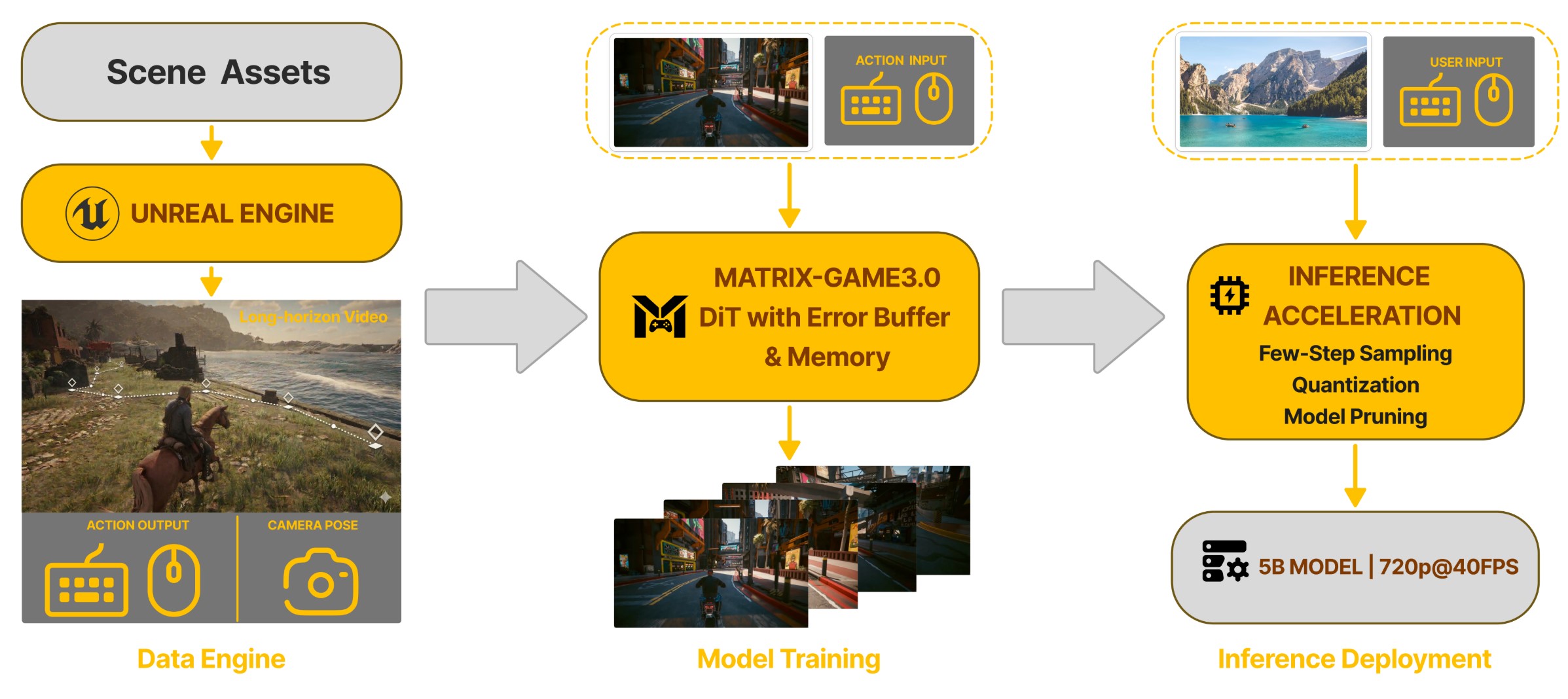

Matrix-Game 3.0是由中国AI公司Skywork AI(昆仑万维旗下天工AI团队)于2026年3月27日发布的开源AI模型,属于一种交互式可控世界模型,设计用于实时生成可交互的虚拟游戏世界视频。该模型采用Memory‑augmented Diffusion Transformer架构,通过集成“数据引擎、模型训练、推理部署”三阶段pipeline,支持长时序一致性和高质量实时交互生成,能够在720p分辨率下实现最高约40FPS实时生成。Matrix-Game 3.0具备长时记忆能力和动作条件(键盘/鼠标)响应,可用于游戏世界构建、模拟交互与虚拟环境探索等场景。目前Matrix-Game 3.0是开源的,提供了模型权重与代码示例,支持通过API/脚本方式进行集成与调用。在参数规模方面,该模型在轻量部署下约为5B参数,并可扩展为更大规模MoE架构,在生成过程可结合Memory检索机制来保持长期一致性与物理规则的连贯性,代表开放式世界模型方向的重要研发成果之一。

Matrix-Game 3.0的核心功能

- 实时交互世界生成:Matrix-Game 3.0支持在720p分辨率下实现约40FPS实时交互视频生成,用户可以通过键盘或鼠标指令在虚拟世界中动态操控角色与视角,模型即时响应输入并生成连贯环境变化。

- 长时序一致性记忆:该模型集成Memory增强机制,可在生成中检索历史帧作为记忆条件,保证用户在长时间交互后重回原位置仍能维持场景稳定与结构一致。

- 动作控制与条件注入:支持将输入的键盘动作与鼠标视角输入作为控制信号注入Diffusion Transformer,使生成环境对用户操作具备精确响应,提高交互灵敏度与连贯性。

- 多源数据引擎生成:Matrix-Game 3.0的数据引擎融合来自Unreal Engine合成数据、AAA游戏采集与现实世界视频增强的数据流,以生成高质量Video‑Pose‑Action‑Prompt多模态训练样本。

- 开放API与集成能力:作为开源模型,用户可通过提供的数据与提示调用接口将Matrix-Game 3.0集成到游戏引擎或模拟环境中,支持自定义场景与交互逻辑的开发。

Matrix-Game 3.0的技术原理

- Memory‑augmented Diffusion Transformer:核心架构采用带记忆增强机制的Diffusion Transformer,通过显式建模误差缓冲与历史帧检索,将长期记忆与当前生成融合,提高长时序视频生成的一致性。

- 错误缓冲机制:在训练阶段模型计算预测残差并注入误差扰动,使其在推理阶段对累积错误具有自我校正能力,从而避免长时间运行后场景漂移或失真现象。

- 多模态数据条件融合:模型将视觉帧、动作控制、摄像机位姿和提示词多模态对齐输入,联合建模环境状态与交互条件,使生成过程同时响应用户操作与环境视觉约束。

- 自回归蒸馏与推理加速:训练过程中引入自回归蒸馏策略,将复杂生成过程压缩为少步推理,同时结合INT8量化与轻量化VAE解码器,加速至近实时性能。

- 数据引擎与生成一致性:通过Unreal Engine合成与AAA游戏数据自动采集,构建大规模高质量Video‑Pose‑Action数据集,为模型提供丰富的交互场景与连续状态变化实例。

Matrix-Game 3.0与主流模型对比

| 维度 | Matrix-Game 3.0 | Matrix-Game 2.0 | DeepMind Genie 3 |

|---|---|---|---|

| 上下文记忆能力 | 长时序记忆增强,可返回历史场景一致性 | 主要依赖短序列上下文 | 记忆机制闭源实现,不公开细节 |

| 实时FPS能力 | 约40FPS实时生成 | 约25FPS实时生成 | 机构内部实现实时优化 |

| 参数规模 | 5B轻量+可扩展 | 约17B参数 | 未知闭源参数 |

| 数据源 | Unreal + AAA +现实视频增强 | 主要合成与Minecraft数据 | 未知闭源数据集 |

| 开源支持 | 完全开源 | 开源 | 闭源 |

| 控制精准性 | 高,基于动作注入 | 高于普通视频模型 | 内部优化强 |

上表显示,Matrix-Game 3.0在长时记忆、一致性与实时性方面相较于Matrix-Game 2.0有显著提升,同时作为开源方案,它与Genie 3在实时与记忆机制上各有侧重点。2.0致力于实时长序列生成,而3.0进一步解决了记忆一致性和性能效率问题。Genie 3作为闭源竞品在细节性能上难以公开比较,但Matrix-Game 3.0的开源属性使其更易于研究与产业应用。

如何使用Matrix-Game 3.0

- 环境准备:配置Python环境并安装依赖,建议使用conda创建虚拟环境,安装FlashAttention等加速库,为推理和训练提供最佳性能。

- 模型获取:通过官方开源仓库下载Matrix-Game-3.0模型与权重,将模型文件置于指定目录,并准备好合适的GPU资源以支持实时推理运行。

- 数据准备:准备输入图像或初始场景素材,结合用户动作控制提示(键盘/鼠标输入),作为模型推理时的控制条件进行长时序生成。

- 推理调用:调用推理脚本设置参数,如分辨率、帧数、动作序列等,通过GPU推理生成连续交互视频输出至指定保存路径。

- 调参与集成:可调整Diffusion步数、量化等级和动作权重等参数,以在实时性和质量之间找到合适平衡,并集成至应用场景如游戏引擎或模拟环境中。

Matrix-Game 3.0的项目地址

- 项目官网:https://matrix-game-v3.github.io/

- GitHub仓库:https://github.com/SkyworkAI/Matrix-Game/tree/main/Matrix-Game-3

- HuggingFace模型库:https://huggingface.co/Skywork/Matrix-Game-3.0

- 技术论文:https://github.com/SkyworkAI/Matrix-Game/blob/main/Matrix-Game-3/assets/pdf/report.pdf

Matrix-Game 3.0的典型应用场景

- 交互式游戏开发:在游戏制作过程中,开发者可以利用模型实时生成动态场景和环境反馈,为玩家提供可控的开放世界交互体验。

- 虚拟训练与模拟:用于具身智能训练仿真,通过模型生成连续变化的虚拟环境,帮助智能体学习长期策略与空间推理。

- 影视预可视化:在电影制作初期,可用模型快速生成场景动态预览,结合动作控制提示调整镜头与场景布局。

- 教育与研究模拟:在教育领域通过世界模型生成互动式学习场景,让学生在可控虚拟世界中探索物理规律与空间关系。

- 交互演示平台:用于展示交互式AI生成技术效果,为展会或产品演示提供实时生成的虚拟环境互动演示。

关于Matrix-Game 3.0的常见问题

Matrix-Game 3.0是否开源?

Matrix-Game 3.0是开源的,包含模型代码和权重,支持研究与应用集成,但复杂的部署环境仍需GPU资源与依赖配置,初学者需要参考官方示例进行环境搭建。

该模型支持API调用吗?

模型本身支持以推理脚本形式调用,用户可在本地或服务器环境中通过Python API触发模型推理流程,从而集成至自定义服务或应用。

多模态能力如何体现?

Matrix-Game 3.0通过Video-Pose-Action多模态数据作为输入条件,将视觉帧、动作控制与环境状态联合建模,使模型在生成过程中同时响应用户操作与视觉约束。

需要什么硬件资源?

为实现接近实时的生成性能,建议使用高性能GPU设备,如A100或H100,并配备充足显存与内存,以支持Diffusion Transformer与解码器的并行推理。

该模型适合哪些用户?

Matrix-Game 3.0适合游戏开发者、AI研究人员及虚拟仿真领域用户,尤其适用于需要实时交互世界生成和长期场景一致性的应用场景。

浙公网安备33010202004812号

浙公网安备33010202004812号