LLM Wiki 快速摘要

- 工具名称:LLM Wiki(Large Language Model Wiki 知识库模式)

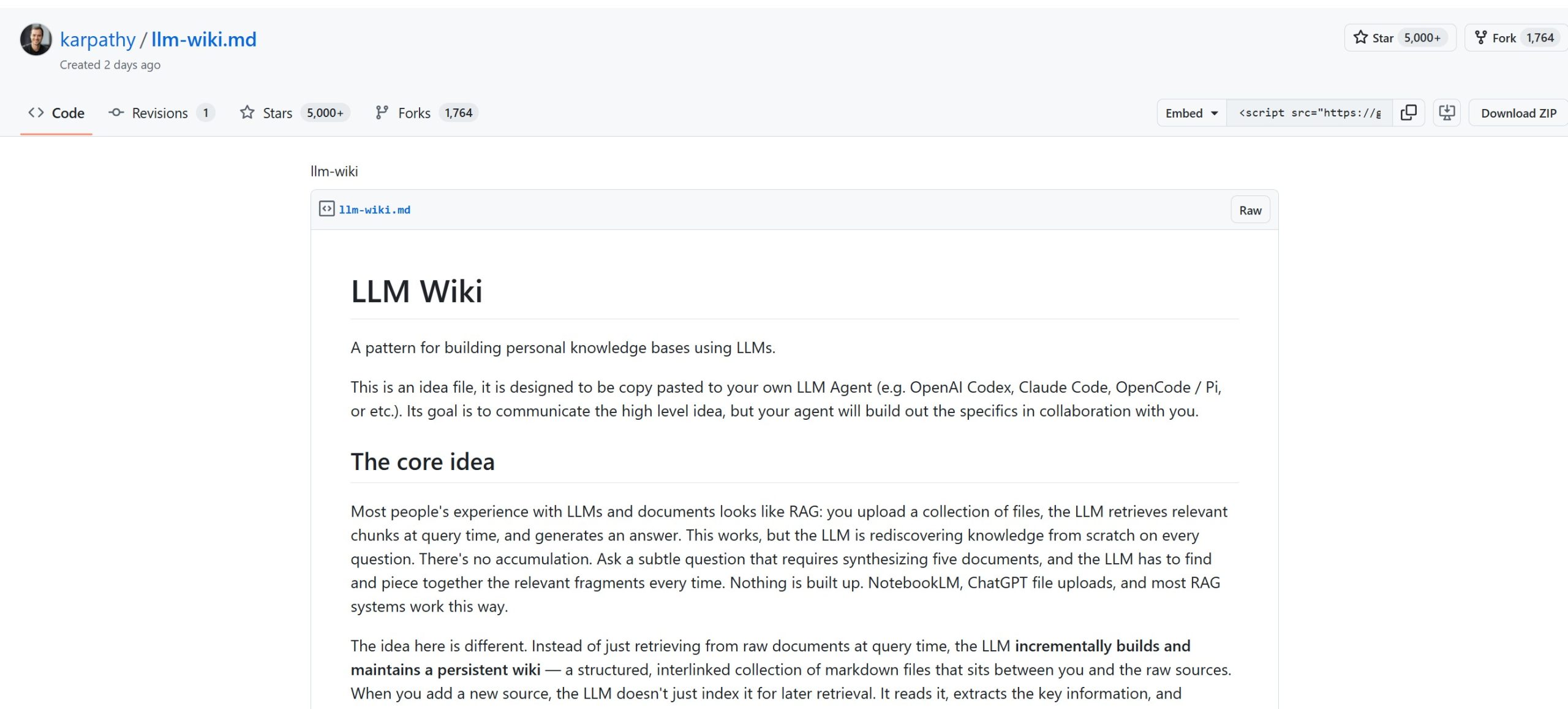

- 开发公司:由 AI 研究者 Andrej Karpathy 发布的开源“idea file”知识库模式,据官方 GitHub gist 发布说明属于非商业产品

- 发布时间:2026 年 4 月 4 日根据 GitHub gist 创建时间显示发布 (未作为正式产品发布)

- 主要功能:不是具体应用产品,而是定义一种让 LLM 构建并维护持久 wiki 知识库的模式,以便累积知识并持续用于高级查询与综合分析

- 技术特点:基于大语言模型增量构建结构化Markdown wiki 知识库;替代传统基于向量检索的 RAG 流程,实现知识持久化与复用

- 使用方式:作为“idea file”在个人 LLM agent 中配合 Obsidian 等本地 Markdown 编辑器使用,需结合 LLM agent 实现与具体工作流程

- 价格说明:完全开放的概念文件,无收费机制;具体实现取决于用户选择的 LLM agent(各种框架或云 API 可能收费)

- 适用人群:AI 工程师、知识管理者、研究人员与高级 LLM agent 工作流实践者

LLM Wiki 的核心优势

- 持久化知识积累优势:LLM Wiki 模式通过让大语言模型增量生成并维护结构化 Markdown 页面来构建知识库,据官方 GitHub gist 说明该模式不会像传统 RAG 那样每次查询都重建上下文,能让知识随着时间积累、复用而不丢失,这种积累性显著减轻了重复检索与推理负担。

- 累积性查询效率提升:根据第三方资料介绍,在传统 RAG 系统中对于复杂多文档问题需要多次检索原始数据并重构上下文,而采用 LLM Wiki 模式后检索本质上是在已维护的 wiki 上进行,有效避免检索碎片化数据的重复计算,从而显著提高复杂查询效率及准确性。

- 跨文档综合能力增强:据第三方评析显示,结构化 wiki 知识库通过 LLM 自动关联实体和主题,比靠单纯向量检索更利于 LLM 进行跨文档综合推理,这对于研究类任务和长期项目分析等场景尤为显著。

- 开放无锁定模式:作为概念性文件公开发布的 LLM Wiki 模式本身不依赖特定模型或框架,用户可基于任意支持代码和 Markdown 的 LLM agent 进行定制实现,不存在供应商锁定问题,能够灵活接入本地或云 LLM 服务。

- 与现有工具兼容性强:据官方说明,该模式与 Obsidian、Web Clipper 以及用户本地语料库等常见工具兼容,可结合 Markdown 生态体系实现可视化浏览与编辑,有利于知识库维护与人工审查。

- 容错性与可审计性:由于知识库由 Markdown 页面形式保存在用户本地或版本控制仓库中,每次变更可通过版本控制审计,而不是黑箱向量数据库,有利于追踪历史、更正错误和可控验证。

LLM Wiki 的主要功能

- 知识累积与导入:该模式定义了“原始资料导入”机制,通过将各种文本、文件、链接等作为 Raw source 输入,LLM 负责提取关键信息并转化为结构化 Markdown 页面,解决了信息散乱无序难以查询的问题。

- 自动生成 Wiki 页面:LLM 根据导入的原始内容自动撰写概要、实体页面和概念页面,从而将分散的知识统一载入 wiki,帮助用户减少手动整理工作。

- 跨文档链接与实体关联:LLM Wiki 模式强调建立页面之间的超链接和概念关联,用以创建内部可导航的知识图谱,使查询和复用更高效。

- 索引与日志维护:模式定义了

index.md和log.md文件结构,分别用于内容目录和事件追踪,使 wiki 结构有序且可追溯。 - 查询与复述:在用户提出查询时,LLM 检索 wiki 页面进行综合回答,并可将新的洞见或分析再次写回 wiki 中,形成自我生长的循环。

- 模式自定义:通过自定义 schema 文件(如

CLAUDE.md或AGENTS.md)用户可以定义 wiki 结构和维护规则,使模式适配不同领域和任务需求。

如何使用 LLM Wiki

- 准备原始资料:收集需要构建知识库的资料,包括文本、文章、报告等,统一以 Markdown 或易于处理的格式存放,以便后续被 LLM 读取与分析;资料组织越清晰,后续页面生成与链接越高效。

- 选择合适的 LLM agent:选用支持代码执行、Markdown 输出的 LLM agent(如 OpenAI Codex、Anthropic Claude Code 等),将 Karpathy 提供的 LLM Wiki idea file 加载到 agent 工作流中,使其作为 wiki 构建规则与约定。

- 导入 Raw sources:按照 wiki 模式将原始文件放入 Raw source 目录,然后命令 LLM agent 执行“

ingest”操作,LLM 会提取资料要点并生成初始 wiki 页面。 - 生成与维护索引:LLM agent 会根据生成的页面更新 index.md 文件,提供内容目录,随后用户可以在 Obsidian 等工具中浏览和验证这些页面结构是否符合预期。

- 查询并扩充:通过向 LLM agent 发起查询,模型不再每次从原始数据读取,而是基于 wiki 内容综合回答,用户可以将新的分析结果写回 wiki 作为新页面或更新逻辑链接。

- 周期性维护与纠错:定期进行“

lint”检查,让 LLM agent 识别矛盾、缺失或孤立页面,及时调整或补充资料,以确保 wiki 长期健康。

LLM Wiki的项目地址

LLM Wiki 的应用场景

- 个人知识管理:对于研究者或深度学习者,在长期阅读论文、文章和资料过程中可使用此模式将散乱信息转化为结构化 Wiki,据官方说明该模式可帮助快速定位已积累的知识,不必每次从零重构。

- 项目内文档综合分析:在长期项目开发过程中集成会议记录、设计文档与讨论,将其导入 wiki,可实现跨文档实体链接与自动摘要,提高跨团队协作效率。

- 复杂问题调研:研究复杂主题时,可多次导入不同来源,LLM Wiki 会将信息综合并提炼成可查询页面,从而节省重复阅读与手动整理时间。

- 课程笔记与学习系统:学生或讲师可以将课程笔记、教材章节整理为 wiki 页面,并用 LLM 进行结构化导航,使复习和查询更高效。

- 知识库内部审计:企业内部建立知识库时,此模式可用来持续消除冲突、更新陈旧观点,保持知识库一致性并减少维护人力。

LLM Wiki 的价格与付费方案

- 成本结构:LLM Wiki 本身是一个开放模式定义,没有产品化价格;成本主要来自所选 LLM agent 与计算资源(如 API 调用费或本地模型运行成本)。

- API 调用费用:若使用商用 API(如 ChatGPT、Claude 等),需支付各自服务费用,通常按 token 消耗计费;成本取决于查询量与生成页面规模。

- 本地部署成本:选择本地运行开源模型,可无 API 成本但需自行承担硬件与维护费用,这对长期项目有成本优势。

- 性价比评估:对于需要长期维护知识库的团队或个人,采用本地大型模型结合 LLM Wiki 模式,可减少重复检索和 API 成本,有助控制长期预算。

使用 LLM Wiki 时需要注意的问题

LLM Wiki 并非传统意义上的工具软件,而是一个“知识库构建模式”,其效果取决于所选的 LLM agent 与原始资料质量。新手需具备一定的 LLM agent 配置能力和 Markdown 处理常识,否则难以高效搭建;此外,持续维护 wiki 需要审查和纠错,以避免模型输出中的不准确信息被永久写入知识库。

LLM Wiki 与其他同类工具的对比分析

为便于理解 LLM Wiki 在知识管理和 AI 辅助写作场景的优势,现与国内顶流产品 腾讯 ima 及国外顶流产品 NotebookLM 进行对比。

| 对比维度 | LLM Wiki | NotebookLM | 腾讯 ima |

|---|---|---|---|

| 知识模式 | 主动编译,持续累积 | 被动检索,每次从零拼凑 | AI 自动整理知识库,但支持持续累积和多端同步 |

| 维护主体 | LLM 全职维护(自动更新多页、标注矛盾) | 无维护,每次临时检索 | 腾讯官方团队维护,支持自动更新和团队协作 |

| 核心架构 | 三层分离:raw(只读)/wiki(LLM写)/Schema(规则层) | 单层:原始资料直接作为检索源 | 多层结构:知识存储层 + AI 问答层 + 协作层 |

| 索引机制 | Markdown 索引文件(中等规模免向量库) | 向量嵌入 + 相似度检索 | 向量 + 图谱索引结合,支持大规模数据检索 |

| 可定制性 | 白盒控制:通过 CLAUDE.md 自定义页面格式、更新规则、工作流 | 固定流程:无法干预检索和生成逻辑 | 可配置规则和模板,支持团队自定义知识管理流程 |

| 输出沉淀 | 优质回答可归档回 Wiki,形成新页面 | 回答消失于对话历史 | 可保存且结构化归档,支持团队共享和多端调用 |

| 技术门槛 | 仅需 Markdown 文件 + Obsidian | 依赖 Google 基础设施 | 低门槛,支持可视化操作与 AI 辅助导入 |

说明:

- LLM Wiki 适合熟悉 Markdown、追求白盒化和可控性的个人或小团队。

- NotebookLM 更偏向个人问答型辅助,依赖 Google 生态,灵活性低。

- 腾讯 ima 在国内用户中属于顶流产品,兼顾团队协作、自动化知识整理和多模态支持,适合企业或大规模知识库管理。

关于 LLM Wiki 的常见问题

LLM Wiki 怎么用?

LLM Wiki 不是单一产品,而是由 Karpathy 定义的“idea file”模式,通过将其加载到支持代码执行和 Markdown 输出的 LLM agent 工作流中,然后导入原始资料以生成和维护 wiki 页面,实现知识的累积和查询。

LLM Wiki 支持 API 吗?

LLM Wiki 本身没有 API;其运行取决于所选的 LLM agent 是否提供 API 接口,如使用 OpenAI 或 Anthropic API,因此能否通过 API 访问 wiki 内容取决于 agent 实现。

LLM Wiki 免费吗?

LLM Wiki 概念文件本身免费开源,但若结合商用模型调用则会产生 API 费用,选择本地模型则无 API 费用但需要自行承担计算资源成本。

LLM Wiki 与 RAG 有什么不同?

LLM Wiki 通过让 LLM 逐步构建持久 wiki 而不是每次检索原始文件,从而将知识保存下来;传统 RAG 系统每次需检索并拼接信息再回答,两者在知识积累和查询体验上有本质差异。

LLM Wiki 适合哪些人群?

LLM Wiki 适合需要持续整理大量文档、进行长期深入研究的个人或团队,特别是熟悉 Markdown 流程和 LLM 工具链的高级用户。

LLM Wiki 是否支持多模态?

LLM Wiki 概念本身支持通过将原始资料扩展到带图片等内容的 Markdown 页面,但是否支持图像或视频依赖于具体 LLM agent 处理能力。

LLM Wiki 初始化难吗?

由于需配置 LLM agent、理解 wiki 结构与操作流程,对新手有一定门槛;建议先熟悉 Markdown 编辑器和所选 LLM agent 配置再实践。

总结:LLM Wiki 是否值得推荐?

LLM Wiki 不是单一产品,而是由 Andrej Karpathy 发布的用于指导 LLM 构建持久知识库的模式,适用于长期项目、复杂调研和知识累积需求。其核心优势在于知识积累与复用,但需要技术背景配置 LLM agent 和维护流程,不适合零基础用户;对于需要组织大量资料并提升查询效率的研究者和团队而言,这种模式能提升长期生产力。

浙公网安备33010202004812号

浙公网安备33010202004812号